En el contexto actual de la ciberseguridad, los programas de inteligencia no solo manejan datos, sino que también los convierten en activos estratégicos fundamentales para la protección de la infraestructura digital. El procesamiento y la normalización de datos han emergido como pilares esenciales que determinan la efectividad global de las funciones de seguridad. Hoy en día, las organizaciones recopilan ingentes cantidades de información proveniente de sensores, plataformas de seguridad, infraestructuras, aplicaciones y fuentes externas de inteligencia de amenazas. Sin embargo, el verdadero desafío ya no radica en la escasez de datos, sino en su sobreabundancia, su heterogeneidad y la calidad contextual deficiente, que pueden enturbiar el panorama.

Desde una visión estratégica, la normalización de datos no debe ser vista simplemente como una tarea técnica destinada a “compatibilizar” diferentes formatos, sino como un proceso clave para alinear la inteligencia de ciberseguridad con los objetivos de negocio. La experiencia nos ha enseñado que sin modelos de datos consistentes, taxonomías comunes y criterios claros sobre severidad y confianza, incluso los esfuerzos de inteligencia más sofisticados pueden convertirse en ruido operativo, generando informes de poco valor y decisiones reactivas en lugar de preventivas

Este blog realizará un análisis/reflexión sobre Procesamiento y normalización de datos en la inteligencia de ciberseguridad:

Los autores, Kyle Wilhoit y Joseph Opacki, en su libro Operationalizing Threat Intelligence, mencionan que uno de los factores que más limitan la operacionalización de la inteligencia es la incapacidad de transformar datos crudos en conocimiento útil a lo largo de toda la organización. La normalización actúa como un habilitador clave para romper los silos entre fuentes internas y externas, permitiendo la correlación, el enriquecimiento y el análisis con sentido operativo y estratégico.

En la práctica, la ausencia de procesos maduros de procesamiento y normalización genera múltiples efectos adversos: duplicidad de indicadores, inconsistencias en la clasificación de incidentes, falsos positivos recurrentes y una sobrecarga constante para los equipos de análisis. Esto no solo afecta la eficiencia operativa, sino que erosiona la confianza de los niveles ejecutivos en la función de seguridad al percibir reportes que no reflejan con precisión el riesgo real ni su impacto en la organización

Por el contrario, cuando la normalización se implementa de forma disciplinada apoyada en marcos como MITRE ATT&CK, modelos de datos bien definidos y reglas claras de calidad de la información, la inteligencia de ciberseguridad evoluciona hacia un esquema verdaderamente accionable. Los indicadores dejan de ser simples artefactos técnicos y se convierten en señales priorizadas, contextualizadas y vinculadas a escenarios de amenaza relevantes para el negocio. Esto permite no solo mejorar la detección y la respuesta, sino también anticipar patrones, ajustar controles y orientar las decisiones de inversión.

Los incidentes recientemente reportados a nivel global confirman esta realidad. En múltiples brechas significativas, los indicadores de compromiso estaban presentes con antelación en los sistemas, pero no fueron identificados a tiempo debido a la fragmentación y falta de normalización de los datos. Este fenómeno evidencia que la inteligencia no falla por ausencia de señales, sino por incapacidad de interpretarlas de manera coherente y oportuna.

Desde el rol de liderazgo en seguridad, el procesamiento y la normalización de datos deben ser impulsados como una capacidad organizacional transversal, que combine tecnología, procesos y gobierno. No basta con adquirir herramientas avanzadas de SIEM, SOAR o XDR; es indispensable definir estándares, responsabilidades y métricas que aseguren la consistencia y confiabilidad de la información. Solo así la inteligencia puede escalar desde el nivel operativo hasta el estratégico, apoyando decisiones de alto impacto relacionadas con el riesgo, la continuidad y la reputación.

Ejemplo del mundo real del procesamiento de datos crudos a inteligencia accionable:

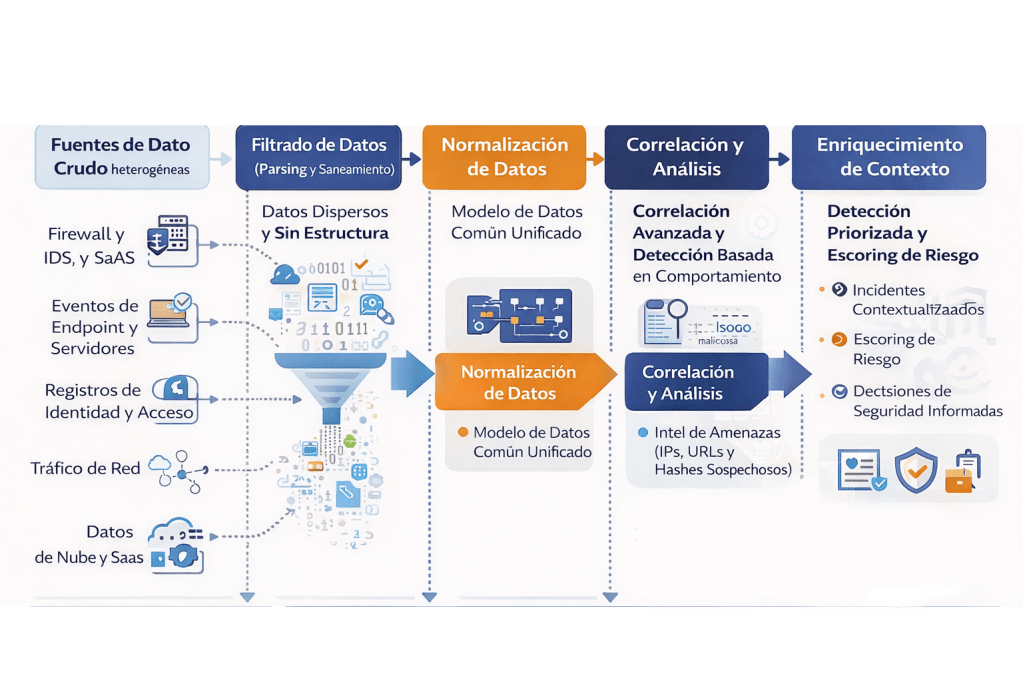

La imagen ilustra cómo la inteligencia de ciberseguridad se construye a partir de la transformación progresiva de datos crudos y heterogéneos en inteligencia accionable. Las organizaciones recolectan información de múltiples dominios: red, endpoint, identidad, nube y aplicaciones, pero esta información, por sí sola, solo proporciona una visibilidad parcial y fragmentada.

El procesamiento inicial permite filtrar y estructurar los datos, pero el punto crítico del modelo es la normalización. Al unificar formatos, semánticas y criterios (usuarios, activos, tipos de evento y severidad), los datos dejan de ser aislados y se vuelven comparables entre sí. Esta normalización es lo que habilita la correlación efectiva y el análisis basado en el comportamiento.

Gracias a ello, eventos técnicos dispersos se convierten en patrones de ataque que pueden enriquecerse con inteligencia de amenazas y priorizarse según el riesgo e impacto en el negocio. El resultado final ya no son alertas, sino incidentes contextualizados y decisiones informadas.

Fuentes:

- Wilhoit, K., & Opacki, J. (2022). Operationalizing Threat Intelligence [Video]. Packt Publishing. O’Reilly Learning Platform, https://learning.oreilly.com/videos/operationalizing-threat-intelligence/9781837632879/.

- Santos, R., & Maymi, F. (2022). Operationalizing threat intelligence. Packt Publishing. https://learning.oreilly.com/library/view/operationalizing-threat-intelligence/9781801814683/

- MITRE Corporation. (2023). MITRE ATT&CK®: Adversarial tactics, techniques, and common knowledge. https://attack.mitre.org/

- Stellar Cyber. (2024). Stellar Cyber Open XDR Platform.

Leave a comment